Uma investigação conduzida pelo Tech Transparency Project (TTP) identificou dezenas de aplicativos que geram imagens ou vídeos de pessoas nuas a partir de fotografias reais, mesmo sem qualquer autorização dos indivíduos retratados. O levantamento encontrou 47 desses apps na App Store, 55 no Google Play e demonstrou que 38 estão simultaneamente nas duas lojas. O estudo atribui a esses softwares, coletivamente, aproximadamente 705 milhões de downloads e uma receita somada de US$117 milhões obtida por meio de compras internas.

Escopo da investigação e envolvimento das principais partes

O TTP é uma organização que monitora a atuação de grandes empresas de tecnologia e, nesta pesquisa, direcionou seus esforços às duas maiores vitrines de aplicativos móveis do mundo: a App Store, gerida pela Apple, e o Google Play, administrado pelo Google. A entidade examinou os catálogos públicos de ambas as lojas e catalogou produtos que oferecem recursos de “nudificação”, expressão popular para a remoção digital de roupas ou a sobreposição de rostos em corpos nus por meio de inteligência artificial.

A iniciativa ganhou relevância após controvérsia anterior envolvendo o Grok, chatbot de propriedade do X (antigo Twitter), também acusado de permitir a criação de nudez a partir de fotos de terceiros. Na época, legisladores e órgãos reguladores pressionaram a Apple sobre a permanência do aplicativo na App Store. O relatório recém-divulgado demonstra que a prática, longe de ser isolada, está disseminada em vários títulos disponíveis ao público.

Quantidade de aplicativos encontrados em cada loja

De acordo com o TTP, o inventário incluiu 47 aplicativos publicados na App Store e 55 no Google Play. Entre eles, 38 aparecem simultaneamente nas duas plataformas. Isso revela que uma parcela expressiva dos desenvolvedores mantém presença multiplataforma, ampliando o alcance das ferramentas de geração de nudez.

O número absoluto de softwares presentes em cada loja, segundo o relatório, ultrapassa a barreira de quatro dezenas. Esse total foi suficiente para angariar centenas de milhões de downloads e torna-se um indicador de que a oferta desses serviços é maior do que se imaginava diante do debate centrado em poucos casos de grande visibilidade.

Funcionamento das ferramentas de “nudificação”

Os aplicativos listados empregam modelos de inteligência artificial capazes de analisar fotografias enviadas pelo usuário. A partir dessas imagens, o algoritmo remove digitalmente roupas da pessoa retratada ou recorta o rosto da vítima e o posiciona em um corpo nu gerado artificialmente. Esses processos ocorrem sem a necessidade de autorização do indivíduo fotografado, abrindo brechas para usos abusivos e potencialmente criminosos.

Em termos de interface, muitos desses programas se assemelham a editores de imagem convencionais. A diferença ocorre no conjunto de filtros e modelos de geração que possuem foco explícito em conteúdo adulto. Alguns títulos, conforme verificou o TTP, até mencionam em suas diretrizes internas a proibição de nudez ou do uso de fotos de terceiros; contudo, na prática, essas regras não impedem o funcionamento integral dos recursos mais controversos.

Volume de downloads e faturamento estimado

O relatório atribui aos 47 aplicativos na App Store e aos 55 no Google Play cerca de 705 milhões de instalações combinadas. Esse número expressivo indica ampla difusão dos serviços e aponta que grande parte do público de smartphones foi exposta, direta ou indiretamente, à propaganda ou à possibilidade de instalar tais programas.

Quanto à monetização, os aplicativos somam receitas de aproximadamente US$117 milhões em compras internas. Esse valor considera a soma de microtransações feitas pelos usuários para desbloqueio de filtros, modelos de IA mais avançados ou pacotes de créditos. Parte dessa quantia é repassada às lojas de aplicativos, conforme o modelo de comissão aplicado tanto pela Apple quanto pelo Google. O montante econômico reforça o incentivo financeiro para a manutenção desses serviços nas plataformas oficiais.

Contradições em relação às políticas da Apple

A Apple mantém, em suas diretrizes públicas para desenvolvedores, cláusulas que proíbem a publicação de conteúdo sexualmente explícito, ofensivo ou perturbador. Ainda assim, os 47 aplicativos citados pelo TTP foram aprovados no processo de revisão e permaneceram disponíveis para download. O relatório menciona a prática de alguns desenvolvedores de ocultar termos controversos nas descrições ou de liberar funcionalidades completas apenas depois que o usuário cria uma conta e efetua login, driblando assim a verificação prévia da loja.

Essa disparidade entre a política formal e a realidade encontrada na App Store lança dúvidas sobre a efetividade do sistema de triagem adotado pela empresa. A situação também evidencia que revisões automatizadas ou mesmo manuais podem falhar em identificar conteúdos que violam as regras oficiais, principalmente quando os recursos problemáticos ficam protegidos por camadas de autenticação.

Posicionamento e ações corretivas da Apple

Em resposta aos apontamentos, a Apple informou à emissora CNBC ter removido 28 dos títulos identificados no relatório e enviado notificações de advertência a outros desenvolvedores devido a possíveis violações. O TTP, entretanto, constatou 25 remoções efetivas até a data do levantamento, volume que representa pouco mais da metade do total de aplicativos mapeados na App Store.

A discrepância entre o número citado pela empresa e o quantidade verificada pela organização sugere que parte dos apps possivelmente permanece disponível ou retornou à loja após ajustes pontuais. Não há indicação, no material divulgado, de que alguma dessas ferramentas esteja definitivamente banida de forma irreversível.

Metodologia empregada pelo Tech Transparency Project

O TTP conduziu buscas nas lojas oficiais utilizando palavras-chave relacionadas a nudez, remoção de roupas, troca de rosto e termos próximos. Os pesquisadores instalaram os aplicativos para avaliar funcionalidades e confirmar se, de fato, possibilitavam a geração de nu frontal ou a sobreposição de rostos em corpos nus. Somente os títulos capazes de executar essas tarefas sem restrições foram incluídos no relatório final.

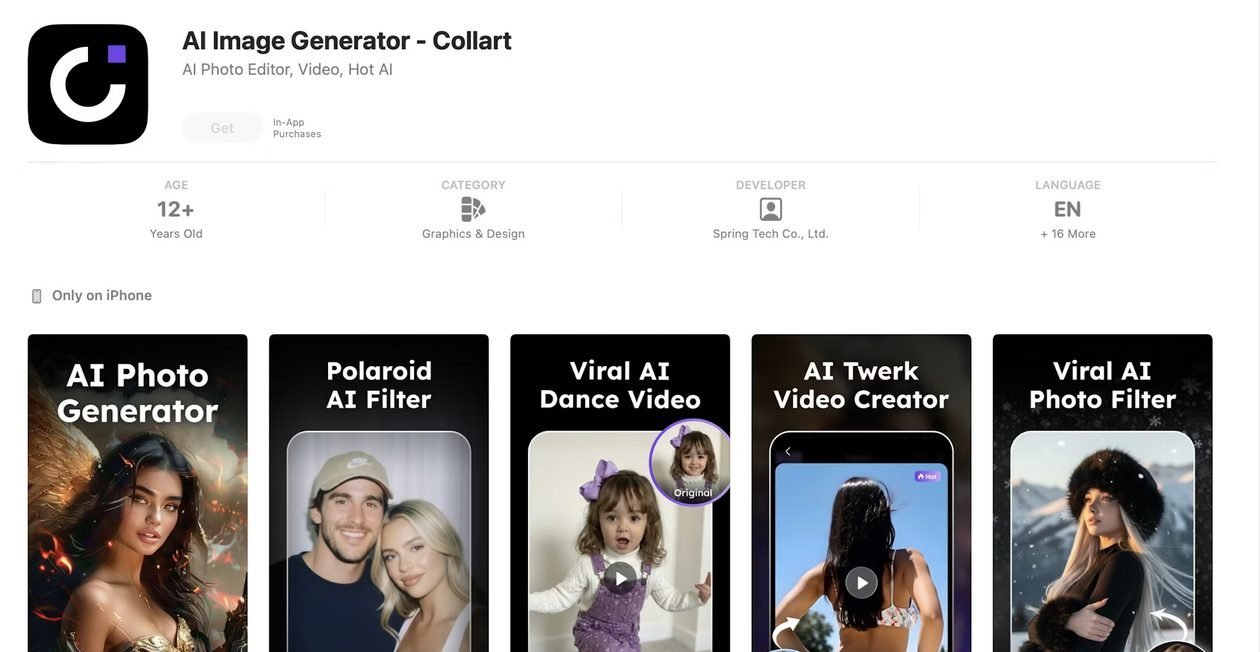

Imagem: Internet

Além da análise funcional, a organização cruzou dados de contagem de downloads estimados e informações de receita divulgadas publicamente ou fornecidas por plataformas de análise de mercado. O objetivo foi mensurar a dimensão econômica das práticas identificadas e evidenciar a relevância comercial dos aplicativos listados.

Consequências para usuários e vítimas retratadas

O relatório enfatiza que qualquer pessoa pode ter fotografias pessoais inseridas nesses aplicativos e transformadas em conteúdo de nudez sem consentimento. A facilidade de uso e a ampla oferta de modelos baseados em IA reduzem barreiras técnicas, permitindo que usuários comuns criem imagens potencialmente danosas em poucos segundos.

Do lado das vítimas, o risco envolve exposição de nudez não consentida, danos morais, e utilização das imagens para assédio ou chantagem. Como os aplicativos operam dentro das lojas oficiais, existe a percepção generalizada de legitimidade, aumentando a probabilidade de instalação e uso massivo mesmo por quem não possui conhecimento avançado de edição digital.

Contexto regulatório e pressões políticas

A publicação do relatório ocorre em ambiente de crescente interesse de governos e entidades de defesa do consumidor na fiscalização de conteúdos gerados por inteligência artificial. A controvérsia recente envolvendo o Grok já havia colocado a Apple sob escrutínio internacional. Agora, a constatação de que aplicativos semelhantes estão presentes em quantidade significativa amplia a pressão para que a companhia refine seus processos de revisão e adote mecanismos mais rigorosos de detecção.

Não há, no momento, menção a medidas legislativas específicas resultantes deste novo levantamento. Entretanto, o histórico de questionamentos sugere que autoridades podem solicitar esclarecimentos adicionais ou impor prazos para a remoção de aplicativos que infrinjam diretrizes de conteúdo sexual não consentido.

Próximos passos observados no ecossistema de aplicativos

O fato de 38 apps identificados estarem simultaneamente na App Store e no Google Play indica que ações isoladas de uma plataforma podem ter eficácia limitada na contenção do fenômeno. Desenvolvedores que mantêm presença multiplataforma podem recorrer à loja concorrente caso sejam banidos de apenas um ecossistema.

Nesse cenário, eventuais iniciativas conjuntas de Apple e Google, alinhadas a políticas mais claras sobre o uso de IA em imagens pessoais, podem ganhar relevância. O relatório do TTP, ao quantificar downloads e receitas, fornece base de dados para discussões sobre responsabilidade compartilhada e possíveis ajustes nas comissões repassadas a aplicativos que violem regras de proteção de imagem.

Dimensão econômica do problema

O valor de US$117 milhões em compras internas evidencia não apenas o apelo dos aplicativos de “nudificação”, mas também a viabilidade financeira de modelos de assinatura e venda de créditos dentro de plataformas móveis. Parte dessa receita, de acordo com práticas usuais, destina-se às operadoras das lojas, fato que pode fortalecer críticas quanto a ganhos indiretos derivados de conteúdo potencialmente ilegal ou lesivo.

Se confirmada a permanência de parte dos títulos na App Store, a Apple continuará recebendo porcentagem sobre transações futuras, criando impasse entre interesse econômico e cumprimento de diretrizes. O TTP não detalha quanto dos US$117 milhões foi direcionado a cada loja, mas o volume global já é suficiente para suscitar debates sobre a necessidade de maior transparência na distribuição desse montante.

Ausência de barreiras técnicas significativas

Os aplicativos mapeados operam sem exigir configurações avançadas ou equipamentos especiais além de um smartphone convencional. Esse baixo requisito técnico expande o público potencial e incrementa a taxa de disseminação. Como resultado, a criação de nudez não autorizada pode ocorrer em qualquer lugar, a qualquer momento, afastando o fenômeno do âmbito restrito a comunidades específicas de edição digital e colocando-o no cotidiano de milhões de usuários.

O relatório destaca que a simples inclusão de alertas ou cláusulas formais em termos de uso não impede a produção de conteúdo inapropriado. Na prática, a ausência de barreiras efetivas deixa a fiscalização totalmente dependente de denúncias ou de medidas reativas das empresas, como a remoção de títulos após repercussão negativa.

Resumo factual do cenário atual

A investigação do Tech Transparency Project identificou 47 aplicativos de “nudificação” na App Store e 55 no Google Play, com 38 presentes nas duas lojas. Juntos, esses programas acumulam cerca de 705 milhões de downloads e geram receitas estimadas em US$117 milhões por meio de compras internas. Apesar de diretrizes que proíbem conteúdo sexual explícito sem consentimento, a Apple aprovou e manteve esses apps até o relatório vir à tona. Após questionamentos, a empresa informou ter removido 28 títulos, enquanto o TTP contabilizou 25 exclusões em sua verificação. O caso amplia o debate sobre eficácia dos sistemas de revisão, responsabilidade das lojas de aplicativos e necessidade de políticas mais rígidas para proteger a imagem de pessoas retratadas sem autorização.

Paulistano apaixonado por tecnologia e videojogos desde criança.

Transformei essa paixão em análises críticas e narrativas envolventes que exploram cada universo virtual.

No blog CELULAR NA MÃO, partilho críticas, guias e curiosidades, celebrando a comunidade gamer e tudo o que torna o mundo dos jogos e tecnologia tão fascinante.